Deutsch-Chinesische Enzyklopädie, 德汉百科

IT-Times

IT-Times

Frankreich

Frankreich

Ile-de-France

Ile-de-France

IT-Times

IT-Times

HPC

HPC

Unternehmen

Unternehmen

*Größte Öl- und Gaskonzerne

*Größte Öl- und Gaskonzerne

Wirtschaft und Handel

Wirtschaft und Handel

Wissenschaft und Technik

Wissenschaft und Technik

Global Innovators

Global Innovators

张量处理单元(英文:Tensor Processing Unit,简称:TPU),也称张量处理器,是 Google 开发的专用集成电路(ASIC),专门用于加速机器学习。自 2015 年起,谷歌就已经开始在内部使用 TPU,并于 2018 年将 TPU 提供给第三方使用,既将部分 TPU 作为其云基础架构的一部分,也将部分小型版本的 TPU 用于销售。

Tensor Processing Units (TPUs), auch Tensor-Prozessoren, sind anwendungsspezifische Chips um Anwendungen im Rahmen von maschinellem Lernen zu beschleunigen. TPUs werden vor allem genutzt, um Daten in künstlichen neuronalen Netzen, vgl. Deep Learning, zu verarbeiten.

Die von Google entwickelten TPUs wurden speziell für die Softwaresammlung TensorFlow[1] entworfen. TPUs sind die Basis für alle Google Services, welche maschinelles Lernen einsetzen, und wurden auch in den AlphaGo-Maschine-vs.-Mensch-Wettkämpfen mit einem der weltbesten Go-Spieler, Lee Sedol, zum Einsatz gebracht.[2]

China

China

IT-Times

IT-Times

Spätklassik, Romantik (Früh, Mittel, Spät)

Spätklassik, Romantik (Früh, Mittel, Spät)

Japan

Japan

Republik Korea

Republik Korea

Shandong Sheng-SD

Shandong Sheng-SD

Shanghai Shi-SH

Shanghai Shi-SH

Taiwan Sheng-TW

Taiwan Sheng-TW

Vereinigte Staaten

Vereinigte Staaten

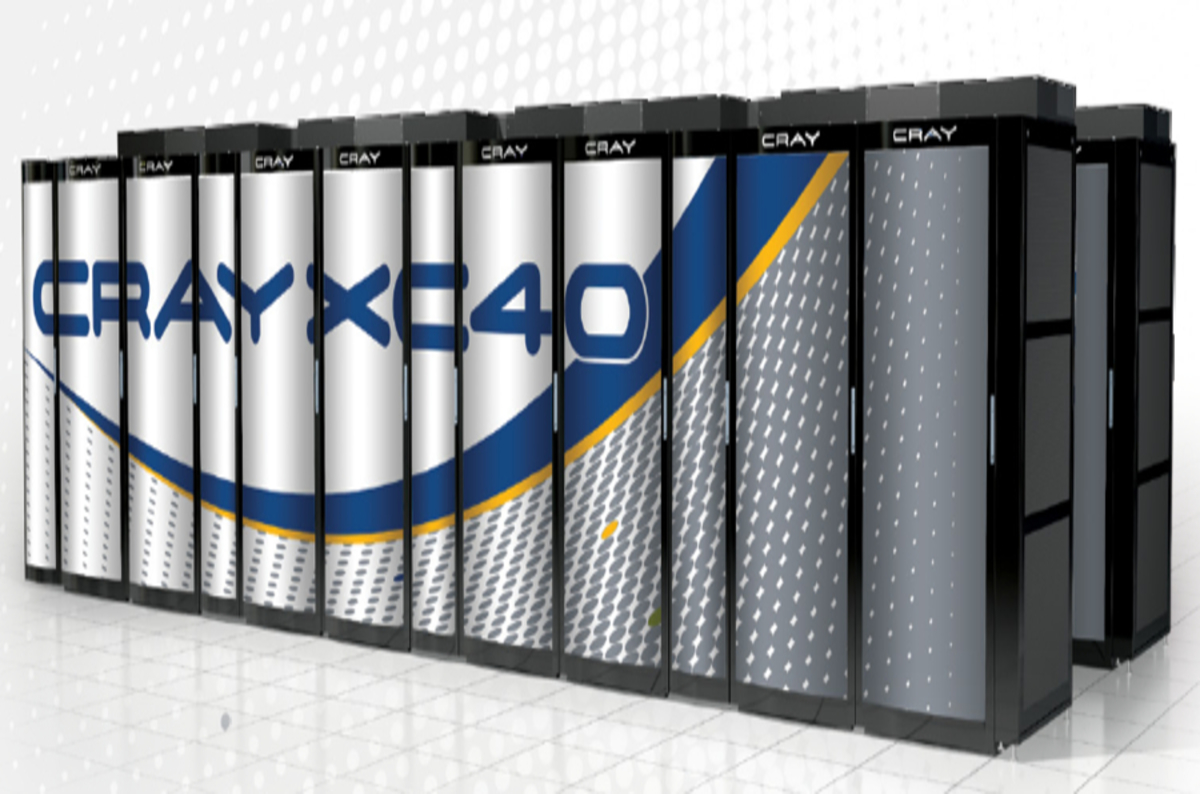

| Site: | DOE/NNSA/LANL/SNL |

|---|---|

| Manufacturer: | Cray Inc. |

| Cores: | 979,968 |

| Memory: | |

| Processor: | Intel Xeon Phi 7250 68C 1.4GHz |

| Interconnect: | Aries interconnect |

| Performance | |

| Linpack Performance (Rmax) | 14,137.3 TFlop/s |

| Theoretical Peak (Rpeak) | 43,902.6 TFlop/s |

| Nmax | 7,176,192 |

| HPCG [TFlop/s] | 546.124 |

| Power Consumption | |

| Power: | 3,843.58 kW (Submitted) |

| Software | |

| Operating System: | Cray Linux Environment |

Energieressource

Energieressource

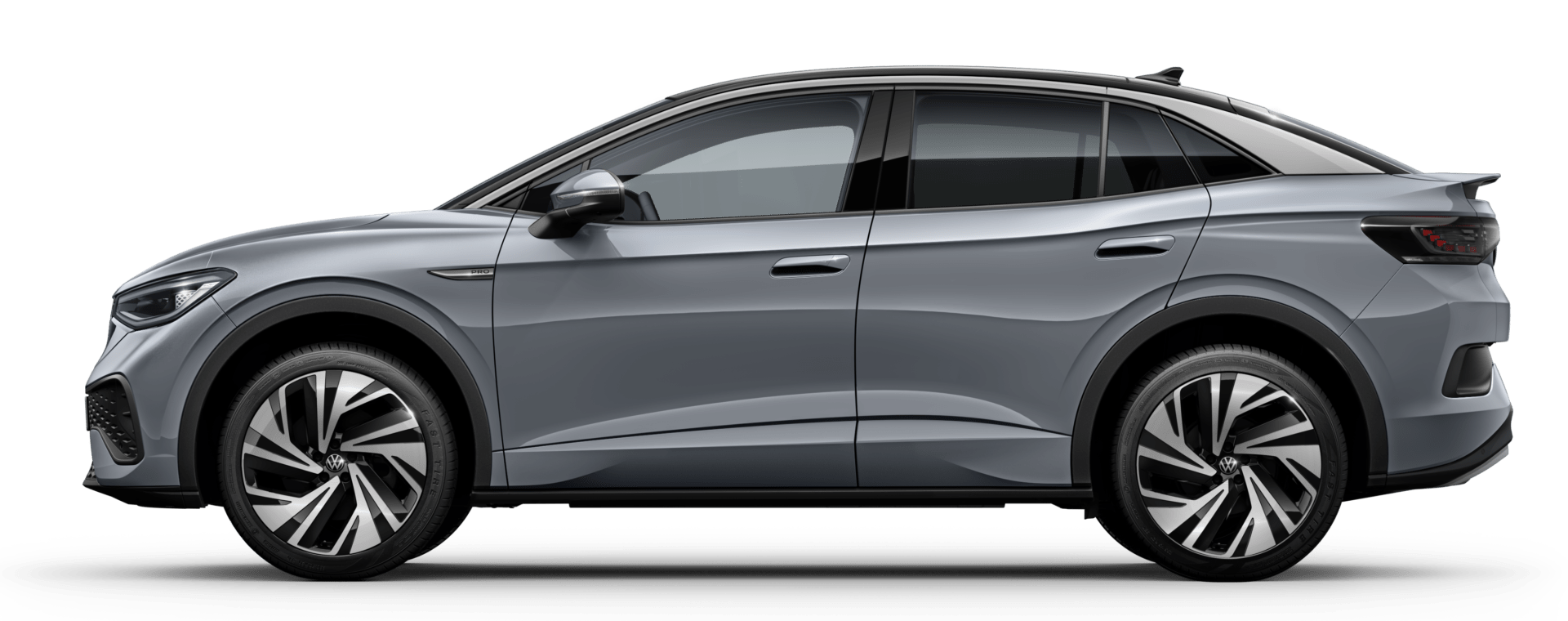

Automobil

Automobil

California-CA

California-CA

Landwirtschaft, Forstwirtschaft, Viehzucht, Fischerei

Landwirtschaft, Forstwirtschaft, Viehzucht, Fischerei